系列データの統計モデリング 〜カルマンフィルタ の導出と実装〜

【概要】

- 系列データのモデリングと状態推定のシリーズ4回目

- 今回は、カルマンフィルタ の導出と実装をやってみます

【目次】

はじめに

統計モデリングを行うにあたって、独立同分布(i.i.d; independent and identically distributed)を仮定することが多いと思います。

しかし、i.i.dを仮定できないケースはよくあります。時系列などの系列データが代表的です。また、i.i.dを仮定することが多い対象でも、計測対象や計測装置の経時的な変化(劣化)など本来的には系列を考慮しないといけない場面はあると思います。

系列データの解析について、主に「予測にいかす統計モデリングの基本」を参考に確認しましたので、数回に分けてまとめていこうと思います。なお、状態空間モデル(State Space Model)を使ったモデリングが対象です。

本シリーズここまでは、パーティクルフィルタを使った状態推定を行ってきました。状態空間モデルの推論についてパーティクルフィルタと同じかそれ以上に有名なものにカルマンフィルタがあります。今回は、カルマンフィルタを利用して時系列データの状態推定を行います。

間違いや勘違いなど、なにかありましたら指摘いただけるとすごく助かります。

| No. | リンク |

|---|---|

| 第1回 | 系列データの統計モデリング 〜パーティクルフィルタによる状態推定〜 - 機械と学習する |

| 第2回 | 系列データの統計モデリング 〜ハイパーパラメータの推定〜 - 機械と学習する |

| 第3回 | 系列データの統計モデリング 〜自己組織型状態空間モデルを利用した状態推定モデルのハイパーパラメータ推定〜 - 機械と学習する |

| 第4回 | これ |

カルマンフィルタ

カルマンフィルタ とは

線形ガウス状態空間モデル(下記)における状態推定のためのアルゴリズムです。線形ガウス状態空間モデルとは、システムモデル、観測モデルが線形結合とガウスノイズで構成された状態空間モデルです。

第1回で紹介した一般状態空間モデルと比較すると、ベースとなる確率分布が限定されますので、ちょっと不便を感じるかもしれません。パーティクルフィルタはこの制限がなく、任意のモデルを適用することができます。

ただ、この制限を課すことで、フィルタ分布が解析的に導出できるので、推論に必要な計算が圧倒的に速いですし、安定した挙動を示します。ハイパーパラメータ*1の考慮もあまりないので使いやすいです。シビアなリアルタイム処理で効果を発揮する気がします(個人的な経験)。

なお本記事では、式のノーテーションは基本的に予測にいかす統計モデリングの基本に基づいています。後述の導出過程は確率ロボティクスを参考にしています。参考にしているというかほぼなぞっただけです。

アルゴリズムの導出

導出過程は確率ロボティクスを完全に信頼してなぞっています。とても丁寧に書かれており、すごくわかりやすいので、詳しく知りたい方は是非確率ロボティクスを参照してもらえたらと思います。カルマンフィルタだけでなく、パーティクルフィルタもわかりやすいです。移動ロボットのSLAMを題材にしていますが、状態空間モデルを確認したい場合にはとてもお勧めです。

状態空間モデルの状態推定についての基本は、第1回で記載の通り、予測分布[tex:p(x_t | y{1:t-1})]とフィルタ分布[tex:p(x_t | y{1:t})]を導出する必要があるのでした。

線形ガウス状態空間モデルでは、上記のシステムモデル、観測モデルは多次元ガウス分布となるため、予測分布とフィルタ分布は定義に従って解析解を導出することができます。

導出の詳細は長くなってしまったので、本記事末にPDFを貼り付けておきます。手書きなのでだいぶ読めないと思いますので(ごめんなさい)、確率ロボティクスなどを参照されることを強くお勧めします。

結論だけを書くと、予測分布とフィルタ分布は以下のガウス分布となります。

アルゴリズム

アルゴリズムは上記のフィルタ分布([tex:p(x_t | y{1:t})])を導出するだけなので、モデルの定義に従って、[tex: \bar{\mu}t, \bar{\Sigma}_t, K_t, \mu_t, \Sigma_t]の順に求めていくだけです。

- 初期状態を適当に設定(

)

- input :

- 予測分布の導出:

の計算

- フィルタ分布の導出:

の計算

- 予測分布の導出:

- 2に戻って繰り返し

実装

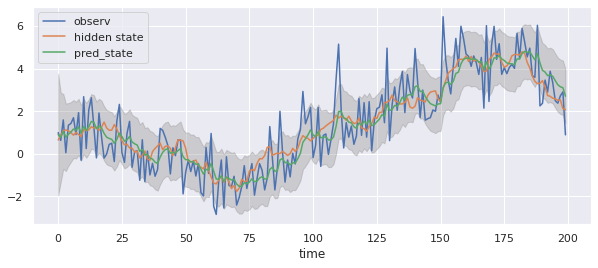

これまでのシリーズと同じ時系列のトイデータを使って状態推定してみます。

このデータを次の状態空間モデルで推論します。

ということで、明らかに線形ガウス状態空間モデルですね。

実装と結果は下記に添付するnotebookに全コードを書いています。まぁ掲載するほどでもないですけどね。結果だけを載せておきます。

全コードはこちらです。

カルマンフィルタクラスはこちらです。

おわりに

ということで、カルマンフィルタの導出を確認し、時系列データの状態推定をに応用してみました。

推論結果多次元ガウス分布になるので、平均と共分散を計算するだけで推論ができます。そのため推論にかかる計算は短かったです。正確な比較をしていないですが、体感で明らかにパーティクルフィルタより速いです(まぁ当然ですが)。

しかし、導出結果だけを利用するなら別になんてことないのですが、フィルタ分布を導出しようとすると行列の計算がけっこう厳しいかったです。圧倒的に数学力が足りない。

次回はパーティクルフィルタとの比較をやってみようと思います。

気になった方、指摘いただけると助かります。

参考資料

[1] 樋口(著), 予測にいかす統計モデリングの基本―ベイズ統計入門から応用まで, 講談社, 2011

予測にいかす統計モデリングの基本―ベイズ統計入門から応用まで (KS理工学専門書)

- 作者:樋口 知之

- 発売日: 2011/04/07

- メディア: 単行本

[2] Sebastian Thrun(著), Probabilistic Robotics, MIT Press, 2005

Probabilistic Robotics (Intelligent Robotics and Autonomous Agents series)

- 作者:Thrun, Sebastian,Burgard, Wolfram,Fox, Dieter

- 発売日: 2005/08/19

- メディア: ハードカバー

手書きの導出メモ

- 確率ロボティクスのXX章にある記述をそのままなぞっています。システムモデルに制御入力が存在しないモデルを扱っているので、その分ちょっと簡単になっています。